Facebook ha cambiato la funzione di selezione degli articoli di tendenza che tanto ha fatto discutere alcuni mesi fa per la denuncia di un ex dipendente della società che si occupava della manipolazione “umana” di quegli argomenti. Menlo Park ha deciso di tagliare di netto la questione, puntando tutto sugli algoritmi. Automazione al posto di umanità è forse lo scenario centrale di questo secolo e nessuno come il social network lo rappresenta.

Del caso “trending” si è parlato in tutto il mondo, anche se non si spiegherebbe senza comprendere il ruolo della campagna elettorale americana. Aveva dato molto fastidio ai repubblicani, infatti, l’ipotesi che alcuni articoli riguardanti Donald Trump fossero cestinati come informazione spazzatura da una redazione ignota dotata di strumenti altrettanto oscuri e discrezionali. Anche se all’epoca Mark Zuckerberg aveva smentito questa ipotesi di una manina politica sulla sezione, la decisione comunicata sembra avvalorare la tesi che la gerarchizzazione delle notizie su un social dove si informano gran parte dei cittadini americani sia diventato un problema politico e non più soltanto tecnico.

Per questo Facebook ha scelto gli algoritmi, parlando di «feedback ricevuti all’inizio di quest’anno»:

Il nostro obiettivo è consentire che Trending raggiunga il maggior numero possibile di persone, e sarebbe difficile basandosi su una selezione degli argomenti di tipo manuale. Un processo più algoritmicamente guidato ci permette di scalare la funzionalità per coprire più argomenti e renderla disponibile a un maggior numero di persone nel mondo nel corso del tempo.

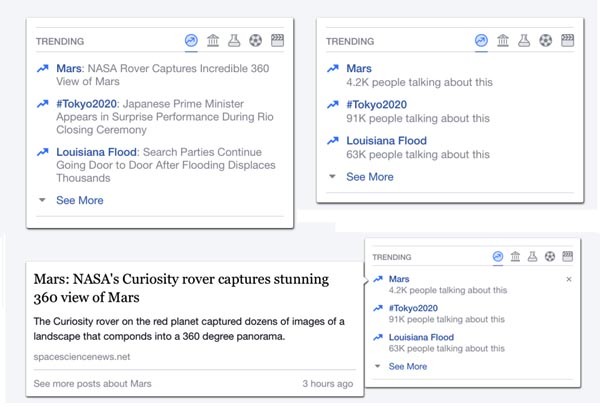

In soldoni, significa che la redazione umana è stata cancellata, mentre resta l’intervento umano ma limitato soltanto a rispettare le linee guida, e che d’ora in avanti ci penseranno gli algoritmi. Il primo effetto visibile di questo passaggio è un’esaltazione degli hashtag collegati a delle notizie di tendenza, dei quali il social visualizzerà sempre anche il numero di visite e like. Un sistema più banalmente numerico sensibile a un eventuale elevato volume di menzioni e un forte aumento di queste in un breve periodo di tempo, che “Trending” riassumerà in brevi estratti.

La sezione Trendig dopo la cura algoritmo cambierà aspetto. A sinistra, la vecchia versione con i microtesti per ogni articoli; a destra, i trending rappresentati con gli hashtag e i nomi. Una volta che l’utente passa su uno di questi – e di ciascuno già si vedono i numeri in continua evoluzione – si apre la finestra con l’estratto dell’articolo.

Ovviamente, resta valido il principio per cui ogni utente vede una versione personalizzata di quell’elenco a seconda dei propri interessi, i fattori sono sempre gli stessi: le pagine che sono piaciute, la posizione geografica, i precedenti argomenti coi quali si è interagito, e ciò che è trend a livello globale. Il tutto somiglierà più a un Google News, dove gli algoritmi premiano i contenuti mettendoli in alto nei risultati, con la differenza che non c’è alcuna query, ma un’ottica globale su quanto viene condiviso e ha importanza di cronaca.

Chi scrive gli algoritmi?

Facebook ha probabilmente cambiato poco del suo vero sistema interno, e il presunto pregiudizio politico era un rischio bassissimo rispetto a come funziona realmente il sito. Molto più interessante, anzi determinante, è capire cosa scelgono gli algoritmi, dato sono comunque scritti da esseri umani. Non esistono scelte neutrali, mai, in nessun caso, quando c’è di mezzo la decisione di organizzazioni a forte componente umana riguardo a processi complessi. Anche un algoritmo conserva l’impronta dei pregiudizi e delle visioni culturali di chi lo ha scritto.

Dunque la scelta di Facebook non è affatto, come si potrebbe pensare, un passo indietro, una scelta neutrale che chiude il dibattito. Mettere la sezione dei contenuti mediatici più rilevanti e discussi in mano a pezzetti di matematica di cui non sappiamo nulla è al contrario una ancora maggiore responsabilità di Facebook. L’opinione pubblica si forma sempre più tramite questi canali: non è mai stato tanto importante e decisivo per la democrazia interrogarsi sul loro funzionamento.

/https://www.webnews.it/app/uploads/2016/07/facebook-1.jpg)

/https://www.webnews.it/app/uploads/2024/04/48-2-9.jpg)

/https://www.webnews.it/app/uploads/2024/04/48-83.jpg)

/https://www.webnews.it/app/uploads/2024/04/48-1-12.jpg)

/https://www.webnews.it/app/uploads/2024/04/bosch-professional.jpg)