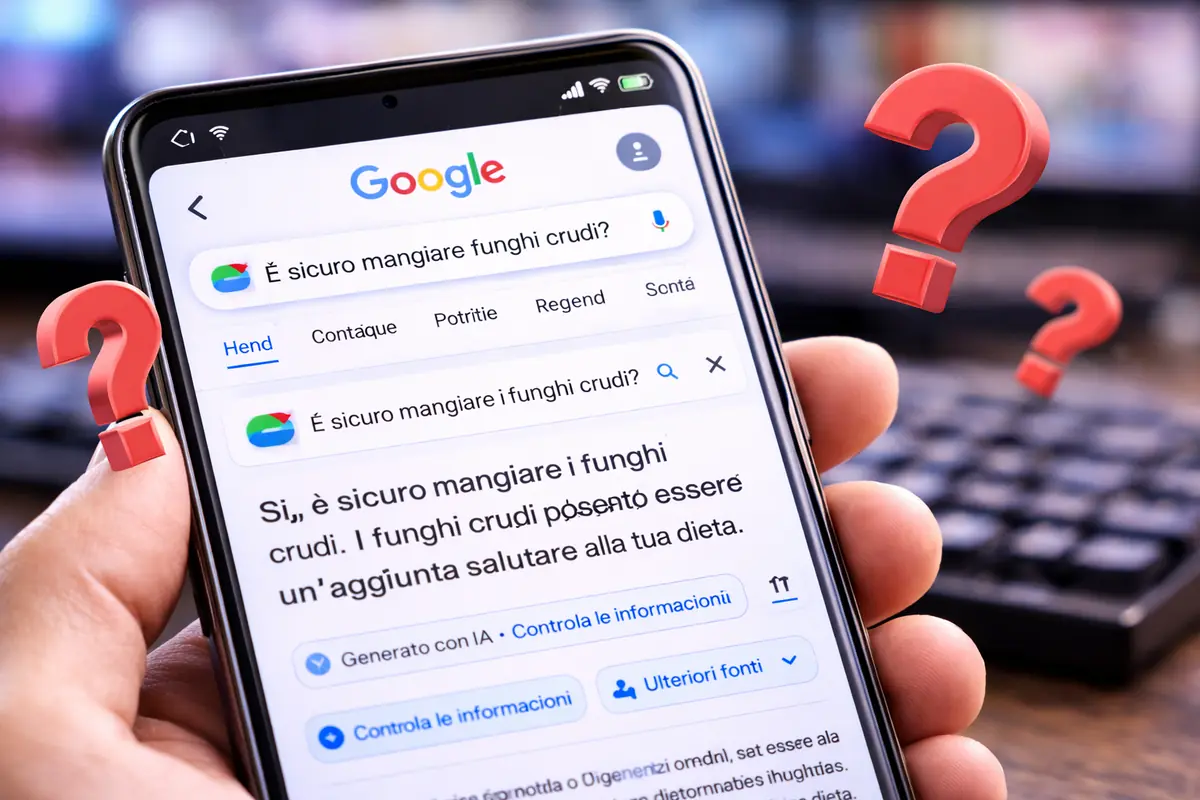

La ricerca con intelligenza artificiale di Google sembra migliorare, ma continua a produrre un numero enorme di risposte sbagliate e il punto più delicato è che spesso l’errore arriva con un tono sicuro e apparentemente affidabile.

Il tema non riguarda solo la qualità tecnica di AI Overview, ma il modo in cui questa funzione si presenta agli utenti. Le risposte generate dall’AI compaiono sempre più spesso direttamente nella pagina di ricerca, prima ancora dei risultati tradizionali, e proprio per questo hanno un peso enorme nella percezione di ciò che è vero. Se un utente legge una sintesi chiara, rapida e ben confezionata, tende a considerarla attendibile. Il problema è che anche un margine di errore relativamente contenuto, applicato ai volumi di Google, diventa gigantesco.

Perché si parla di milioni di risposte sbagliate

Secondo una valutazione realizzata per il New York Times dalla startup Oumi, circa una risposta su dieci tra quelle generate da Google con AI Overview contiene informazioni false. In termini percentuali non sembra una catastrofe assoluta, soprattutto perché il sistema risulta comunque corretto nella maggior parte dei casi. Ma Google gestisce oltre 5 trilioni di ricerche l’anno. Quando si applica un tasso di errore simile a una scala di questo tipo, il risultato cambia completamente: non si parla più di pochi svarioni occasionali, ma di un flusso continuo di risposte inesatte che può toccare milioni di utenti ogni giorno.

Ed è qui che il problema smette di essere teorico. Un errore in una chat privata è una cosa, un errore integrato nel motore di ricerca più usato al mondo è un’altra. L’utente spesso non percepisce la differenza tra una sintesi AI e una risposta verificata in modo tradizionale, soprattutto quando la forma è pulita e il tono è assertivo. Questo rende l’errore più insidioso, perché non sempre appare come dubbio o incerto.

Il nodo più delicato riguarda anche le fonti

Un altro aspetto emerso nei test riguarda le citazioni. Google prova a sostenere le sue risposte con link di supporto, ma non sempre le fonti mostrate confermano davvero ciò che l’AI ha appena scritto. In alcuni casi la sintesi è sbagliata e sotto compare un collegamento che contiene l’informazione corretta. In altri casi, al contrario, la risposta sembra giusta ma rimanda a una fonte poco pertinente o addirittura imprecisa. Questo rende più difficile anche il controllo da parte dell’utente, perché il semplice fatto di vedere un link accanto alla risposta non garantisce affatto che il contenuto sia stato ricostruito bene.

Google contesta il metodo, ma il problema resta

Google ha contestato questa analisi, sostenendo che il test non riflette il comportamento reale delle persone nelle ricerche quotidiane. È un’obiezione da prendere sul serio, anche perché misurare con precisione un sistema del genere è molto complicato. Ma il punto centrale non cambia: la stessa Google avverte gli utenti che le risposte AI possono contenere errori. In altre parole, il rischio non è nascosto, è già ammesso in partenza.

Per questo la questione non è decidere se AI Overview sia utile oppure no. Spesso lo è, e in molti casi accelera davvero la ricerca. Il punto è capire che questa scorciatoia non può ancora essere trattata come una risposta definitiva. Finché il margine di errore resterà abbastanza alto da produrre milioni di risposte sbagliate su larga scala, il vero uso intelligente di queste sintesi sarà uno solo: leggerle come punto di partenza, non come verità già pronta.