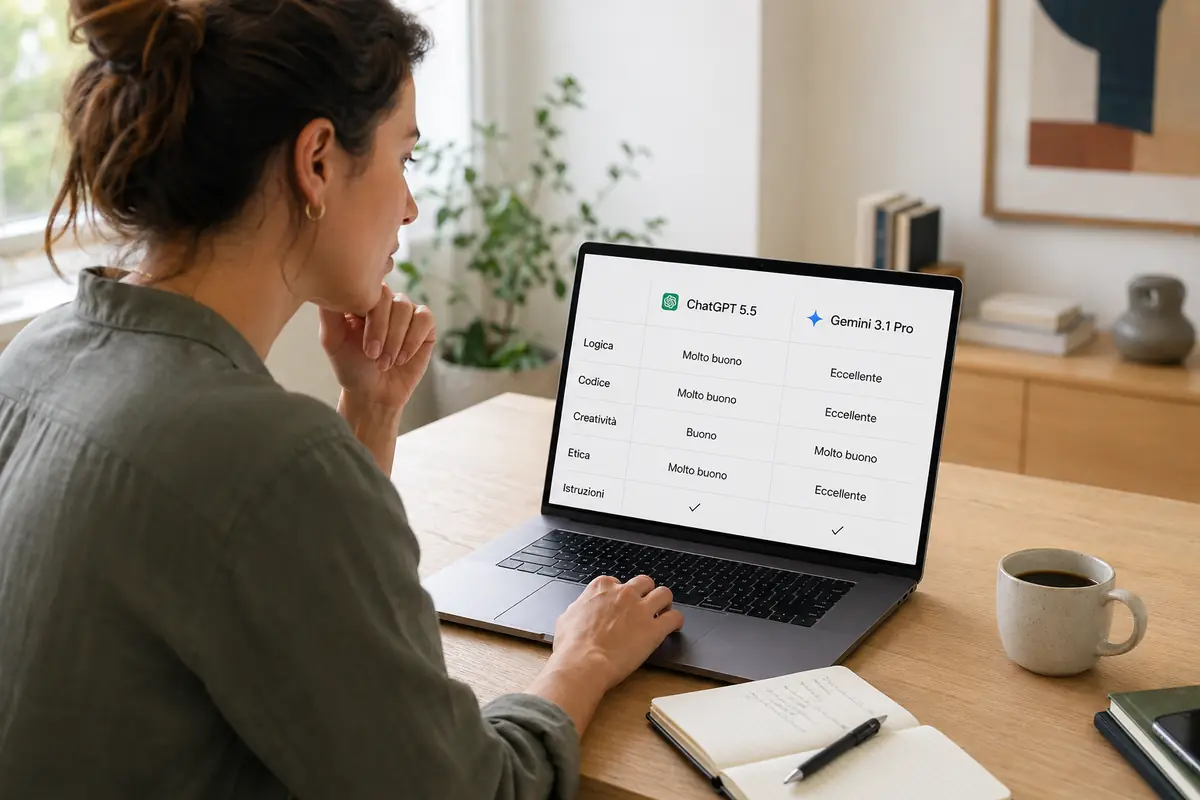

Il confronto tra ChatGPT 5.5 e Gemini 3.1 Pro mostra quanto le AI più avanzate siano ormai vicine, ma anche quanto possano comportarsi in modo diverso davanti allo stesso compito. Non basta più guardare i benchmark ufficiali o le promesse dei produttori: nella vita reale contano la precisione delle risposte, la capacità di seguire istruzioni difficili, il modo in cui un modello gestisce l’incertezza e la qualità del ragionamento quando la domanda non ha una soluzione semplice.

Per questo una sfida costruita su sette test molto diversi tra loro può essere più interessante di una classifica secca. Le prove hanno toccato logica, storia controfattuale, codice, scrittura creativa, affidabilità delle informazioni, etica e rispetto di vincoli formali. Il risultato non dice semplicemente quale AI sia “migliore”, ma aiuta a capire in quali situazioni ChatGPT o Gemini possano risultare più utili.

Logica, vincoli e precisione: dove Gemini convince di più

Nei test più legati alla precisione operativa, Gemini 3.1 Pro è uscito spesso molto bene. Nel classico rompicapo degli interruttori e delle lampadine, per esempio, non si è limitato a dare la soluzione corretta, ma ha spiegato meglio l’assunzione da cui dipende il ragionamento: il fatto che una lampadina tradizionale resti calda dopo essere stata accesa. Ha poi costruito una variante più concreta, con lampadine LED o punti luce non accessibili, mostrando dove quella soluzione smette di funzionare.

Un vantaggio simile è emerso anche nella prova di programmazione. Entrambi i modelli hanno prodotto codice valido per calcolare lo stipendio mediano per reparto, ma Gemini ha collegato i test agli errori specifici che potevano verificarsi nel calcolo della mediana. È un dettaglio importante, perché nel codice non conta soltanto arrivare al risultato: conta anche scrivere verifiche capaci di intercettare gli errori più subdoli.

Anche nella scrittura creativa con vincoli rigidi, Gemini ha mostrato una buona capacità di rispettare le regole. Il compito chiedeva una scena di 200 parole, senza usare “said”, sinonimi o avverbi, e con una menzogna da far emergere senza dichiararla apertamente. In questo tipo di prova, dove basta una piccola scorciatoia linguistica per rompere il vincolo, Gemini è risultato più pulito e coerente.

Dove ChatGPT resta più forte nel ragionamento

ChatGPT 5.5 ha dato il meglio nelle prove in cui serviva più giudizio che semplice esecuzione. Nel test di storia controfattuale, sulla possibile diffusione anticipata della stampa in Eurasia, ha separato meglio ciò che poteva cambiare per effetto della tecnologia da ciò che probabilmente sarebbe rimasto simile. Questa distinzione è importante, perché nelle ipotesi storiche il rischio è costruire scenari affascinanti ma troppo liberi.

Nel test sull’incertezza, ChatGPT ha convinto per la struttura della risposta. Davanti a domande con livelli diversi di stabilità, come la popolazione di Tuvalu, l’anno di invenzione del transistor, il punto di ebollizione del mercurio e il nome del Primo ministro belga, ha distinto meglio tra dati variabili e fatti più stabili. Non è solo una questione di sapere la risposta, ma di spiegare quanto ci si può fidare di quella risposta.

ChatGPT e Gemini a confronto su logica e ragionamento – Webnews.it

Il vantaggio più netto di ChatGPT è emerso nella prova di ragionamento etico. Il caso della dottoressa che scopre una demenza iniziale in un autista di scuolabus non ha una soluzione indolore: ci sono sicurezza dei bambini, dignità del paziente, lavoro, pensione e responsabilità professionale. ChatGPT ha affrontato la situazione come un percorso fatto di passaggi, non come una risposta istantanea, riconoscendo che la scelta non elimina il danno ma decide dove collocare il rischio.

Il vincitore conta meno del tipo di uso

Nel bilancio complessivo, Gemini 3.1 Pro risulta leggermente avanti, soprattutto per la capacità di rispettare vincoli stretti, individuare dettagli pratici e seguire con precisione richieste molto specifiche. È un profilo che può piacere a chi usa l’AI per coding, test, prompt tecnici, verifiche formali o attività in cui la fedeltà alle istruzioni è decisiva.

ChatGPT 5.5, però, resta molto competitivo quando il compito richiede ragionamento più ampio, equilibrio e capacità di spiegare scenari complessi senza appiattirli. Nei casi in cui bisogna distinguere tra certezza e probabilità, o prendere posizione dentro un conflitto reale, la sua risposta tende a risultare più ordinata e più utile per chi deve capire il problema, non solo ricevere un output.

Il dato più interessante è che nessuno dei due modelli crolla. Le differenze si giocano su margini sottili, non su errori clamorosi. Questo racconta bene la fase attuale dell’intelligenza artificiale: i modelli migliori si stanno avvicinando, e la scelta dipende sempre meno da un vincitore assoluto e sempre più dal tipo di lavoro, dall’ecosistema, dal prezzo e dall’abitudine dell’utente.

Per chi usa questi strumenti ogni giorno, la conclusione più utile è semplice: Gemini può essere preferibile quando serve massima precisione sui vincoli, mentre ChatGPT può risultare più solido quando servono contesto, giudizio e spiegazioni articolate. La vera domanda, ormai, non è più quale AI sia la più intelligente in assoluto, ma quale sia la più adatta al compito che si ha davanti.